INTELLIGENCE ARTIFICIELLE : RÈGLEMENT DU 13 JUIN 2024

- Dernière mise à jour : 5 août 2024

1. L'encadrement général des intelligences artificielles

L’Union européenne a déterminé un corpus général et horizontal d’encadrement des technologies d’intelligence artificielle (1).

Les objectifs principaux sont :

- La création d'un marché unique pour le développement et l'utilisation d'une intelligence artificielle digne de confiance ;

- L'organisation d'un niveau élevé de protection pour les personnes physiques et les personnes morales tant du secteur privé que du secteur public ;

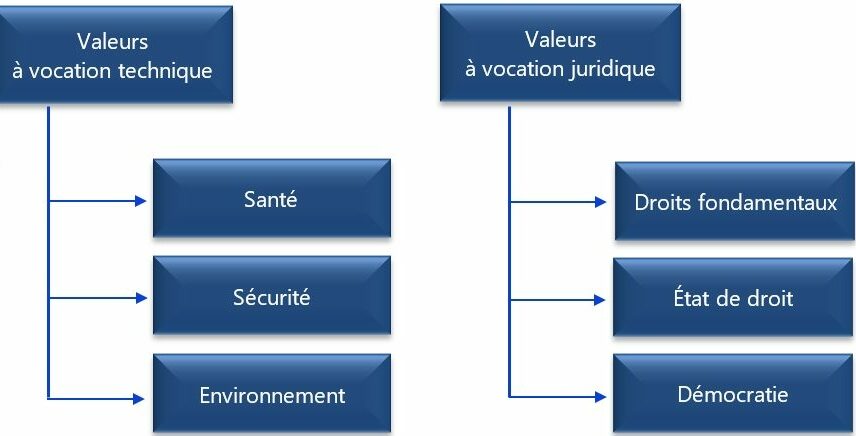

2. Le pilotage juridique des intelligences artificielles

Basées sur les valeurs de l’Union, les protections concernent les éléments suivants :

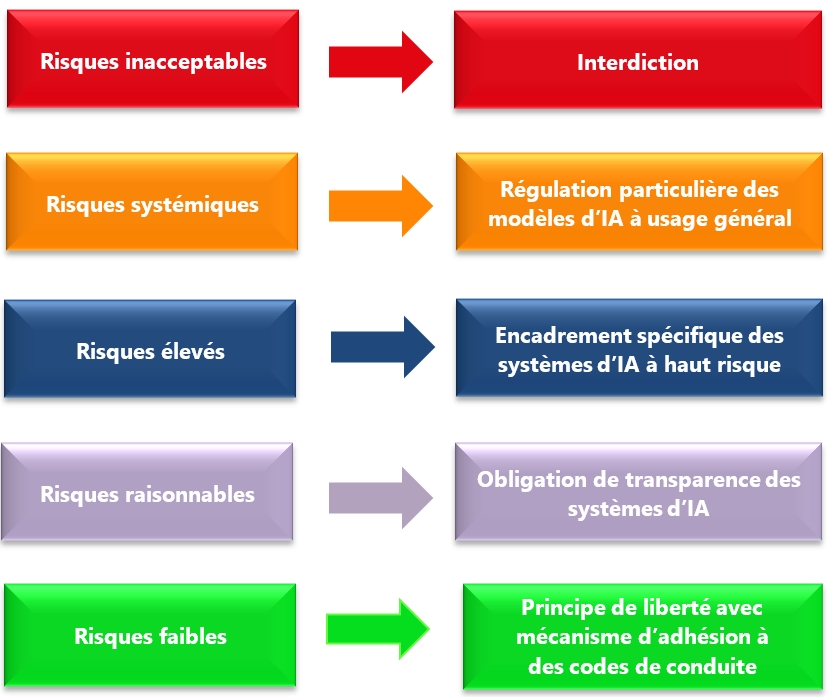

Le pilotage de la protection de ces valeurs fondamentales s’effectue en fonction des risques potentiels selon la nomenclature suivante :

3. Les acteurs régulés

Les principaux acteurs sont (2) :

- les mandataires des fournisseurs tiers

- les distributeurs ;

- les déployeurs (utilisateurs finaux).

4. Les activités régulées

Les opérations sont (2) :

- la conception (faiblement encadrée) ;

- les essais, dont les essais en condition réelle ;

- la mise sur le marché ;

- la mise en service ;

- l'utilisation des résultats produits au sein de l’Union ou provenant de fournisseurs tiers.

5. Les technologies d'Intelligence artificielle

5.1 Présentation technique

Les technologies se répartissent en deux familles :

• l’intelligence artificielle symbolique (ou système expert) ;

• l’intelligence artificielle statistique (dont les réseaux de neurones).

5.2 Présentation juridique

Dans ce cadre, les technologies d’IA se décomposent en trois catégories :

• les systèmes d’IA (le système automatisé qui est conçu pour fonctionner à différents niveaux d’autonomie et peut faire preuve d’une capacité d’adaptation après son déploiement, et qui, pour des objectifs explicites ou implicites, déduit, à partir des entrées qu’il reçoit, la manière de générer des sorties telles que des prédictions, du contenu, des recommandations ou des décisions qui peuvent influencer les environnements physiques ou virtuels) (3)

• les modèles d’IA à usage général (le modèle d’IA, y compris lorsque ce modèle d’IA est entraîné à l’aide d’un grand nombre de données utilisant l’auto-supervision à grande échelle, qui présente une généralité significative et est capable d’exécuter de manière compétente un large éventail de tâches distinctes, indépendamment de la manière dont le modèle est mis sur le marché, et qui peut être intégré dans une variété de systèmes ou d’applications en aval, à l’exception des modèles d’IA utilisés pour des activités de recherche, de développement ou de prototypage avant leur mise sur le marché) (4)

• les systèmes d’IA à usage général (le système d’IA qui est fondé sur un modèle d’IA à usage général et qui a la capacité de répondre à diverses finalités, tant pour une utilisation directe que pour une intégration dans d’autres systèmes d’IA) (5)

5.3 Nomenclature des techniques d'intelligence artificielle

La régulation des techniques d’intelligence artificielle est structurée de la manière suivante :

• les systèmes d’IA interdits ;

• les systèmes d’IA à haut risque

• les systèmes d’IA transparents

• les systèmes d’IA à usage général

• les modèles d’IA à usage général

6. Les systèmes d'IA relevant de pratiques interdites

Il en est ainsi des systèmes ayant pour objet :

• la réalisation d’opérations en dessous du seuil de conscience, manipulatrices ou trompeuses (6)

• l’exploitation de la vulnérabilité des personnes physiques (7)

• la classification de personnes physiques en fonction d’une notation sociale (8)

• la prédiction de la commission d’infractions (9)

• la production des bases de données de reconnaissance faciale (10)

• la détection des émotions (11)

• La détermination des catégorisations biométriques (12)

• l’identification biométrique à distance en temps réel dans les espaces accessibles au public à des fins répressives

7. Les systèmes d'IA à haut risque

Cette catégorie comprends deux familles :

7.1 Les systèmes d'IA à haut risque (Annexe I)

Un système d’IA mis sur le marché ou mis en service, qu’il soit ou non indépendant des produits visés aux points a) et b), est considéré comme étant à haut risque lorsque les deux conditions suivantes sont remplies :

a) le système d’IA est destiné à être utilisé comme composant de sécurité d’un produit couvert par la législation d’harmonisation de l’Union dont la liste figure à l’annexe I, ou le système d’IA constitue lui-même un tel produit ;

b) le produit dont le composant de sécurité visé au point a) est le système d’IA, ou le système d’IA lui-même en tant que produit, est soumis à une évaluation de conformité par un tiers en vue de la mise sur le marché ou de la mise en service de ce produit conformément à la législation d’harmonisation de l’Union dont la liste figure à l’annexe I du règlement. (13)

7.2 Les systèmes d'IA à haut risque (Annexe III )

Les domaines concernés sont :

• la biométrie ;

• les infrastructures critiques ;

• l’éducation et la formation professionnelle ;

• l’emploi, la gestion de la main-d’oeuvre et l’accès à l’emploi indépendant ;

• l’accès et le droit aux services privés essentiels et aux services publiques et prestation sociales essentielles;

• Le domaine répressif ;

• La migration, l’asile et la gestion des contrôles aux frontières ;

• l’administration de la justice ;

• les processus démocratiques (14) ;

8. Systèmes d'IA à usage général

Ils correspondent à des systèmes qui mettent en œuvre ou intègrent des modèles d’IA à usage général.

9. Modèles d'IA à usage général

Ces modèles sont classés en deux catégories : les modèles sans risque systémique et les modèles avec risque systémique. (15)

10. Systèmes d'IA avec obligation de transparence

Ils présentant des risques raisonnables. Les exigences concernant l’obligation de transparence concernent les situations suivantes :

• les modalités d’interaction avec un système d’IA ;

• les précisions sur la fourniture des contenus réalisés par des systèmes d’IA ;

• la reconnaissance d’émotion ;

• la catégorisation biométrique (16).

11. Les sanctions

Elles concernent les trois situations suivantes :

• les systèmes d’IA déployés au sein de l’Union

• les fournisseurs de modèles d’IA à usage général

• les institutions, organes et organismes de l’Union

11.1 Les systèmes d'IA au sein de l'Union

Les amendes administratives sont structurées de la manière suivante : (17)

| THEME | SPECIFICATION | SANCTION |

| Pratiques interdites | Non-respect de l’article 5 | Amendes administratives pouvant aller jusqu’à 35 000 000 € ou, si l’auteur de l’infraction est une entreprise, jusqu’à 7 % de son chiffre d’affaires annuel mondial total réalisé au cours de l’exercice précédent, le montant le plus élevé étant retenu (18) |

| Fournisseurs Non-conformité | Article 16 : Obligations incombant aux fournisseurs de systèmes d’IA à haut risque | Amende administrative pouvant aller jusqu’à 15 000 000 € ou, si l’auteur de l’infraction est une entreprise, jusqu’à 3 % de son chiffre d’affaires annuel mondial total réalisé au cours de l’exercice précédent, le montant le plus élevé étant retenu (19) |

| Mandataires Non-conformité | Article 22 : Obligations des mandataires des fournisseurs de systèmes d’IA à haut risque | |

| Importateurs Non-conformité | Article 23 : Obligations des importateurs | |

| Distributeurs Non-conformité | Article 24 : Obligations des distributeurs | |

| Déployeurs Non-conformité | Article 26 : Obligations incombant aux déployeurs de systèmes d’IA à haut risque | |

| Fournisseurs et déployeurs Non-conformité | Article 50 : Obligation de transparence pour les fournisseurs et les déployeurs de certains systèmes d’IA | |

| Organismes notifiés Non-respect des obligations | Article 31 : Exigences concernant les organismes notifiés Article 33 § 1, 3 et 4 : Filiales des organismes notifiés et sous-traitance. Article 34 : Obligations opérationnelles des organismes notifiés | |

| Informations aux autorités nationales compétentes ou aux organismes notifiés | Inexactes Incomplètes Trompeuses | Amende administrative pouvant aller jusqu’à 7 500 000 € ou, si l’auteur de l’infraction est une entreprise, jusqu’à 1 % de son chiffre d’affaires annuel mondial total réalisé au cours de l’exercice précédent, le montant le plus élevé étant retenu (20) |

11.2 Les fournisseurs de modèles d'IA à usage général

Pour les fournisseurs de modèles d’IA à usage général, les amendes administratives sont distribuées selon les quatre catégories suivantes (17) :

| THEME | MONTANT |

| Non-respect des dispositions du règlement | Amende n’excédant pas 3 % du chiffre d’affaires annuel mondial total réalisé au cours de l’exercice précédent ou 15 000 000 euros, le montant le plus élevé étant retenu |

| Non-application à une demande de documents ou d’informations de la Commission au titre de l’article 91 ou transmission d’informations inexactes, incomplètes ou trompeuses | |

| Non-réponse à une demande de la Commission concernant l’adoption de mesures appropriées dans les cas définis à l’article 93 | |

| Refus d’autoriser l’accès à la Commission au modèle d’IA à usage général ou au modèle d’IA à usage général présentant un risque systémique en vue de procéder à une évaluation conformément à l’article 92 |

11.3 Les institutions, organes et organismes de l'Union

Concernant les institutions, organes et organismes de l’Union, les amendes administratives sont réparties selon les deux catégories suivantes :

| THEME | MONTANT |

| Non-respect de l’interdiction frappant les pratiques visées à l’article 5 | Amende administrative pouvant aller jusqu’à 1 500 000 euros |

| Non-conformité aux exigences ou obligations, autres que celles énoncées à l’article 5 | Amende administrative pouvant aller jusqu’à 750 000 euros |

Cette régulation devrait, à terme, devenir un processeur juridique d’universalité pour une planète humaniste et engagée dans la réalisation des objectifs de développement durable de l’ONU.

(1) Règlement (UE) 2024/1689 art.1

(2) Règlement (UE) 2024/1689 art.2

(3) Règlement (UE) 2024/1689 art.3.1

(4) Règlement (UE) 2024/1689 art.3.62

(5) Règlement (UE) 2024/1689 art.3.66

(6) Règlement (UE) 2024/1689art.5.1.a

(7) Règlement (UE) 2024/1689 art.5.1.b

(8) Règlement (UE) 2024/1689 art.5.1.c

(9) Règlement (UE) 2024/1689 art.5.1.d

(10) Règlement (UE) 2024/1689 art.5.1.e

(11) Règlement (UE) 2024/1689 art.5.1.f

(12) Règlement (UE) 2024/1689 art.5.1.g

(13) Règlement (UE) 2024/1689 Chap.V : art. 6.1

(14) Règlement (UE) 2024/1689 Chap.V : art. 6 à 49

(15) Règlement (UE) 2024/1689 Chap.V : art. 51 à 56

(16) Règlement (UE) 2024/1689 art. 50

(17) Règlement (UE) 2024/1689 Chap.XII art. 99 à 101

(18) Règlement (UE) 2024/1689 Chap.XII art. 99.3

(19) Règlement (UE) 2024/1689 Chap.XII art. 99.4

(20) Règlement (UE) 2024/1689 Chap.XII art. 99.5

(21) Règlement (UE) 2024/1689 Chap.VII art. 64 à 70

(22) Règlement (UE) 2024/1689 art. 113

Règlement (UE) 2024/1689 du 13 06 2024 : texte intégral

Pour en apprendre davantage

Alain Bensoussan

Avocat au barreau de Paris, spécialisé en droit des technologies avancées.

Président du réseau Lexing International

Sommaire

- 1. L'encadrement général des intelligences artificielles

- 2. Le pilotage juridique des intelligences artificielles

- 3. Les acteurs régulés

- 4. Les activités régulées

- 5. Les technologies d'Intelligence artificielle

- 5.1 Technique

- 5.2 Présentation juridique

- 5.3 Nomenclature des techniques d'intelligence artificielle

- 6. Les systèmes d'IA relevant de pratiques interdites

- 7. Les systèmes d'IA à haut risque

- 8. Systèmes d'IA à usage général

- 9. Modèles d'IA à usage général

- 10. Systèmes d'IA avec obligation de transparence

- 11. Les sanctions

- 11.1 Les systèmes d'IA au sein de l'Union

- 11.2 Les fournisseurs de modèles d'IA à usage général

- 11.3 Les institutions, organes et organismes de l'Union

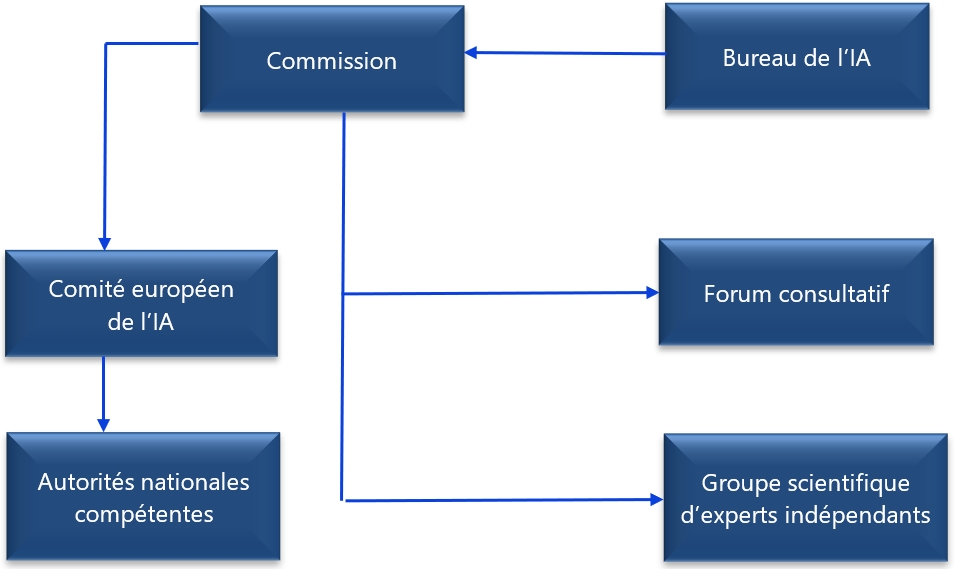

- 12. L'organisation institutionnelle

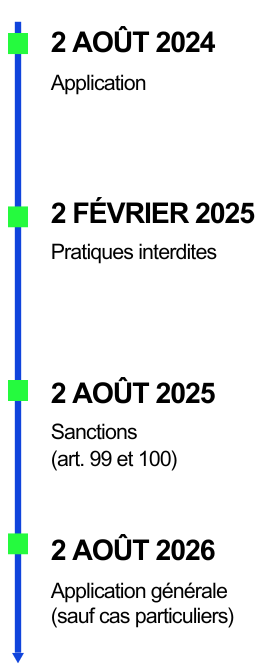

- 13. Le calendrier

- 14. Les perspectives